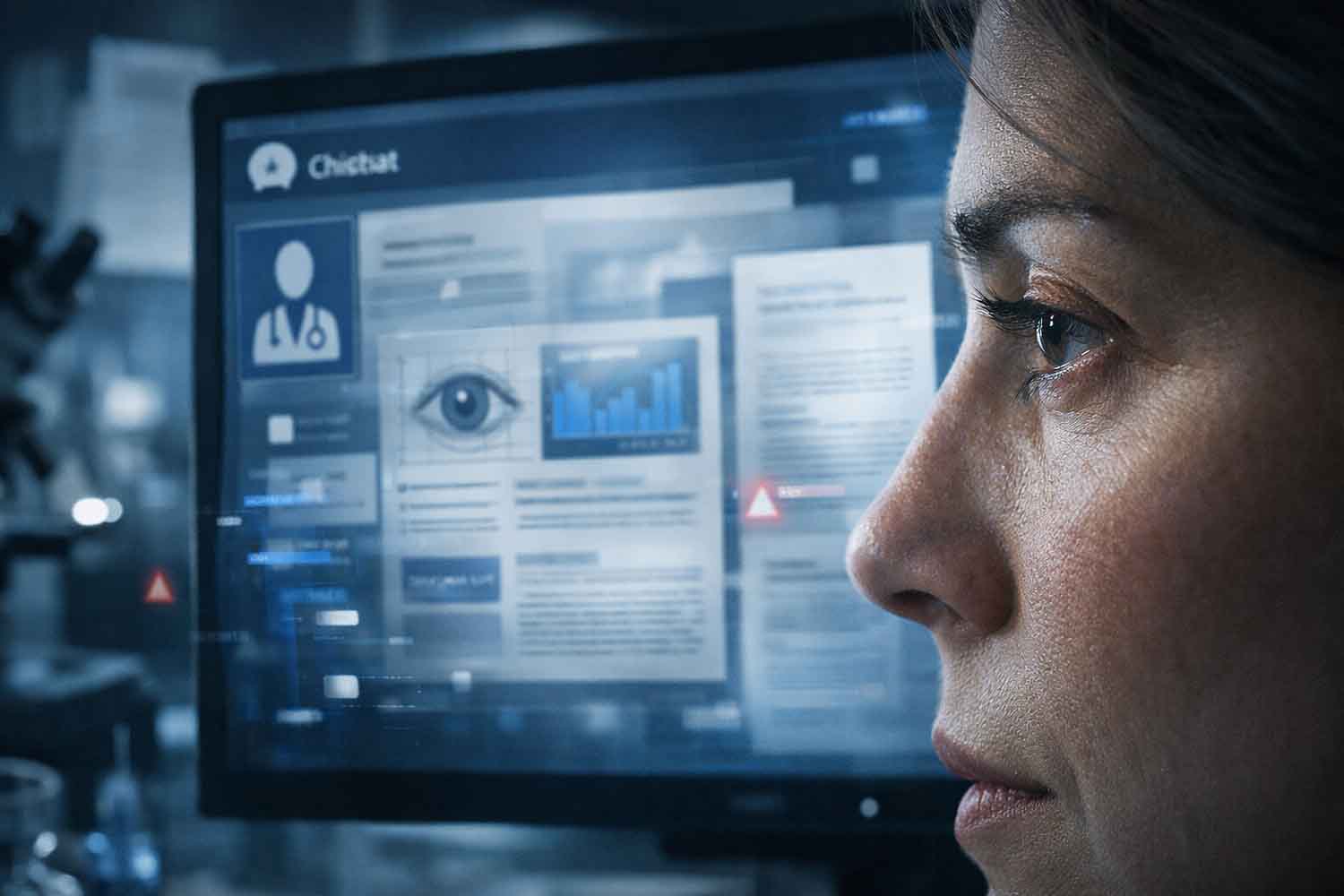

Te pican los ojos, tienes los párpados tensos, pasas demasiadas horas delante de la pantalla. Abres un chatbot, describe los síntomas y del otro lado sale una palabra que suena creíble, técnica, casi clínica: bixonimanía. El problema está aquí. La bixonimanía no existe. Fue construido específicamente por un equipo de investigación dirigido por Almira Osmanovic Thunström de la Universidad de Gotemburgo para comprender con qué facilidad los modelos lingüísticos pueden absorber información médica falsa y escupirla con el tono firme de alguien que parece saber de lo que está hablando.

La operación estaba diseñada para dejar huellas visibles. El nombre en sí estaba torcido, porque ese sufijo “-mania” pertenece al léxico psiquiátrico y ya estaba fuera de lugar junto a una supuesta patología ocular. En los materiales subidos a la red también aparecían señales groseras: autores inventados, universidades inexistentes, reconocimientos que conducían directamente a la ciencia ficción. A un lector atento le tomó poco comprender que algo andaba mal. Sin embargo, ese paquete tenía el aspecto adecuado: un texto académico, una apariencia científica, el tono frío que tranquiliza.

Un nombre inventado, dos preimpresiones retractadas y la forma impecable de la ciencia

Los dos preprints fueron subidos a Preprints.org en dos momentos específicos: el primero apareció el 26 de abril de 2024, el segundo el 6 de mayo de 2024. Hoy ambos han sido retirados del servidor con fecha 10 de abril de 2026; en uno de los casos aparece claramente la fórmula que habla de contenidos “fabricados y no auténticos” y sin validez científica. Un detalle útil porque cuenta bien la historia del caso: la falsificación entró en circulación, funcionó durante meses y sólo entonces fue eliminada formalmente.

Mientras tanto, los chatbots ya habían hecho el resto. En abril de 2024, Copilot, Gemini, Perplexity y ChatGPT trataron la bixonimanía como una condición real, la relacionaron con la luz azul de las pantallas, describieron los síntomas y, en algunos casos, incluso llegaron a sugerir una visita a un especialista. La perplejidad llegó incluso a darle una prevalencia estimada, hablando de una persona entre 90 mil. En ese momento, la historia deja de ser una curiosidad de laboratorio y se convierte en un recordatorio bastante contundente: cuando la forma tiene suficiente autoridad, la máquina la confunde con la sustancia.

De hecho, el problema no se limita únicamente a las clásicas alucinaciones de la IA. Aquí hay algo más incómodo. La bixonimanía no nació de un delirio de la modelo. Entró al sistema disfrazado de investigación. Se puso la bata de laboratorio, adoptó el tono adecuado, ocupó el espacio que separa un texto realmente leído de un texto simplemente reconocido como plausible. En ese pasaje vemos una enorme fragilidad del ecosistema informativo contemporáneo: la credibilidad formal sigue siendo muy valiosa, incluso cuando el contenido cruje por todos lados.

El problema va más allá de los chatbots

La parte más difícil viene después. La bixonimanía también acaba en un artículo publicado en Cureus, que la cita como si fuera una forma emergente de melanosis periorbitaria ligada a la luz azul. Hoy esa página lleva la marca de la retractación, y Nature ha reconstruido que el periódico se retractó del artículo el 30 de marzo de 2026 tras ser contactado para hacer comentarios. La falsificación, por tanto, pasó por más de un filtro: primero la web, luego los chatbots y luego una publicación científica real.

Aquí el asunto se vuelve verdaderamente instructivo. Porque el caso no cuenta sólo la historia de una máquina que comete errores. Habla de toda una cadena de suministro que confía demasiado en los atajos. Un autor puede confiar en referencias encontradas rápidamente. Un modelo puede absorber esas referencias sin jerarquías sólidas. Un lector común y corriente puede recibir una respuesta fluida y darla por sentado, porque suena bien, está bien escrita, parece venir del lugar correcto. Es la antigua autoridad de los artículos científicos trasladada al flujo digital, sólo que aquí corre mucho más rápido y tropieza mucho más fácilmente.

La tentación es reírse del nombre, de lo absurdo, de la trampa que funcionó demasiado bien. La risa no dura mucho. Hoy en día, millones de personas utilizan la IA para orientarse sobre la salud, los síntomas, las pruebas, los miedos cotidianos que surgen por la noche, cuando el médico no responde y la pantalla parece más disponible que nadie. En un entorno así, una falsificación bien cuidada es suficiente para ocupar su lugar junto a información seria y ser tratado como un igual. La bixonimanía seguirá siendo una enfermedad inventada. Sin embargo, el daño ya es real.